¿Podría un LLM leer todo un repositorio Git y sugerir mejoras? ¿Podría soportar el LLM, con su limitación del tamaño de contexto un repositorio Git de un proyecto de Ingeniería Software de un curso de grado?

Vamos a probarlo. Empecemos con una herramienta que captura los ficheros de un repositorio Git y los convierte en un único string que podemos usar en nuestro super-prompt: https://github.com/mpoon/gpt-repository-loader [1]

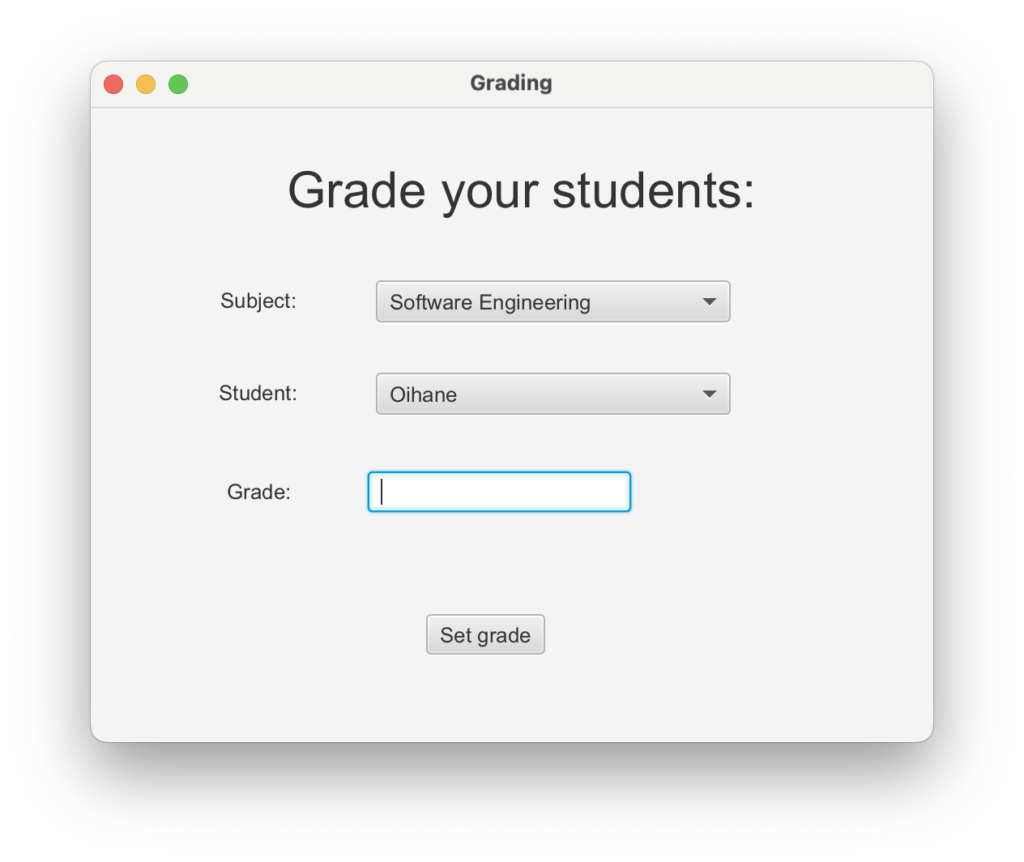

Tomemos ahora un proyecto del curso de Ingeniería Software que imparto en la UPV/EHU: https://github.com/juananpe/facultyproject

Ejecutamos el script:

$ python gpt_repository_loader.py /opt/facultyproject/src/main/java/faculty/project -o /tmp/faculty.txt

Repository contents written to /tmp/faculty.txt.Si echamos un vistazo a /tmp/faculty.txt veremos lo siguiente:

$ head -20 /tmp/faculty.txt

The following text is a Git repository with code. The structure of the text are sections that begin with ----, followed by a single line containing the file path and file name, followed by a variable amount of lines containing the file contents. The text representing the Git repository ends when the symbols --END-- are encounted. Any further text beyond --END-- are meant to be interpreted as instructions using the aforementioned Git repository as context.

----

ui/ApplicationLauncher.java

package faculty.project.ui;

import faculty.project.businessLogic.BlFacade;

import faculty.project.businessLogic.BlFacadeImplementation;

import java.util.Locale;

public class ApplicationLauncher {

public static void main(String[] args) {

System.out.println("Locale: " + Locale.getDefault());

BlFacade businessLogic = new BlFacadeImplementation();

new MainGUI(businessLogic);

Ahí vemos que le ha metido una cabecera («El siguiente texto representa un repositorio Git con código. La estructura del texto son secciones que empiezan con —, seguido por una línea con la ruta al fichero y sus contenidos…)

Al final del fichero (tras el –END–), meteremos la siguiente línea:

Can you suggest how to improve the code?

Y probemos ahora a pasarle el super prompt a un LLM que soporte un gran tamaño de contexto (Gemini Pro 1.5 es un gran candidato):

$ cat /tmp/faculty.txt | llm -m gemini-1.5-pro-latestY el resultado es muy interesante:

Potential Improvements for the Provided Code:

General:

- Dependency Injection: The code currently uses manual object creation, leading to tight coupling. Consider using a dependency injection framework like Spring or Guice to manage object creation and dependencies, improving flexibility and testability.

- Exception Handling: The current exception handling is minimal and sometimes throws runtime exceptions. Implement a more robust exception handling strategy, catching specific exceptions and handling them gracefully with informative messages or logging.

- Logging: Integrate a logging framework like Log4j or SLF4j to track application behavior, debug issues, and monitor performance.

- Testing: Implement unit and integration tests to ensure code quality and prevent regressions. Frameworks like JUnit and Mockito can be helpful.

DataAccess:

- Data Access Object (DAO) Pattern: Instead of having all data access logic directly in DataAccess, consider creating separate DAO classes for each entity (User, Student, Subject, etc.) to improve modularity and maintainability.

- Named Queries: Utilize named queries in JPQL for frequently used queries to improve readability and maintainability.

- Optimistic Locking: Implement optimistic locking to prevent data inconsistencies when multiple users access the same data concurrently.

(puedes ver aquí el resultado completo: https://gist.github.com/juananpe/9ca627a13ca0e1927dfa2c40c86a2af8)

[1]Hay otros proyectos git2txt que hacen lo mismo que gpt_repository_loader: